第二章 信息的度量

2-1 度量信息的基本思路

定义 2.1:若信源发出的消息是离散的、有限或无限可数的符号或数字,且一个符号代表一条完整的消息,则为单符号离散信源

定义 2.2: 若信源的输出是随机事件 X,其出现概率为 ,则它们所构成的集合称为 信源的概率空间 或 信源空间

信源空间的描述:

有

信源输出的事件的概率越小,信息量越大,即信息量是概率的减函数

自信息量 表示 发生所带来的信息量

定义 2.3 自信息量

信息量的单位:

- 以 2 为底:比特 bit

- 以 e 为底;奈特 nat

- 以 10 为底:哈特 Hart

自信息量和不确定度的关系

- 联系:

- 两者都是事件概率的函数,数值和量纲一致

- 区别:

- 不确定度是一个统计量,静态状态下也存在;

- 自信息量只有该随机事件发生时才给出,是动态的概念

2-2 信源熵和条件熵

定义 2.4 信源熵: 其中定义

- 信源熵只与信源符号概率分布有关,是一种先验熵

- 对给定概率分布的信源,信源熵是定值,代表信源每发出一个符号给出的平均信息量,其量纲为 信息量单位 / 信源符号

性质:

- 对称性:交换变量顺序不改变熵的值

- 确定性:若有一个事件必然发生,则熵为 0

- 非负性

- 可加性:对于统计独立的信源 X 和 Y,

- 强可加性对于任意两个信源 X 和 Y,(对数相乘,显然)

- 极值性:等概分布的信源的熵最大,

- 递增性:信源中一个符号划分为 m 个符号,且这 m 个符号的概率和等于原符号概率,则新信源的熵增加,

- 多元信源的熵可以表达为若干二元信源的熵的线性组合

- 严格上凸特性

Jensen 不等式(凹函数定义):

二进制熵函数 ,有

定义 2.5 条件自信息量:

条件概率仅由信道特性决定,看作信道给出的信息量。信源信宿对调也可得到条件自信息量

====

定义 2.6 条件熵:对于联合符号集 XY,在给定 Y 的条件下,用联合概率 对 X 集合的条件自信息量进行加权的统计平均值。

条件熵表示信道所给出的平均信息量

2-3 互信息量和平均互信息量

定义 2.7 互信息量:对两个离散随机事件集合 X 和 Y,事件 的出现给出关于事件 的信息量

- 信道没有干扰:

- 信道存在干扰: x的不确定度-收到y后对x尚存的不确定度=收到y对x所消除的不确定度 当 即互信息量 时,没有信息的流通

性质:

- 对称性:

- 值域为实数:可正可负可零,为负即后验概率小于先验概率,表示收到 y 后对信源是否发送 x 的正确概率小于 x 在信源集合中的概率

- 不大于其中任一事件的自信息量

- 互信息量描述信息流通特性的物理量,流通量的数值不可能大于被流通量的数值

条件互信息量 ,其中 即为条件互信息量

,助记:把 看作后缀,则简化为互信息量的公式

定义 2.8 平均互信息量:

- 为互信息量 的联合概率加权的统计平均值

- 在条件概率空间中的统计平均为

性质:

- 对称性:

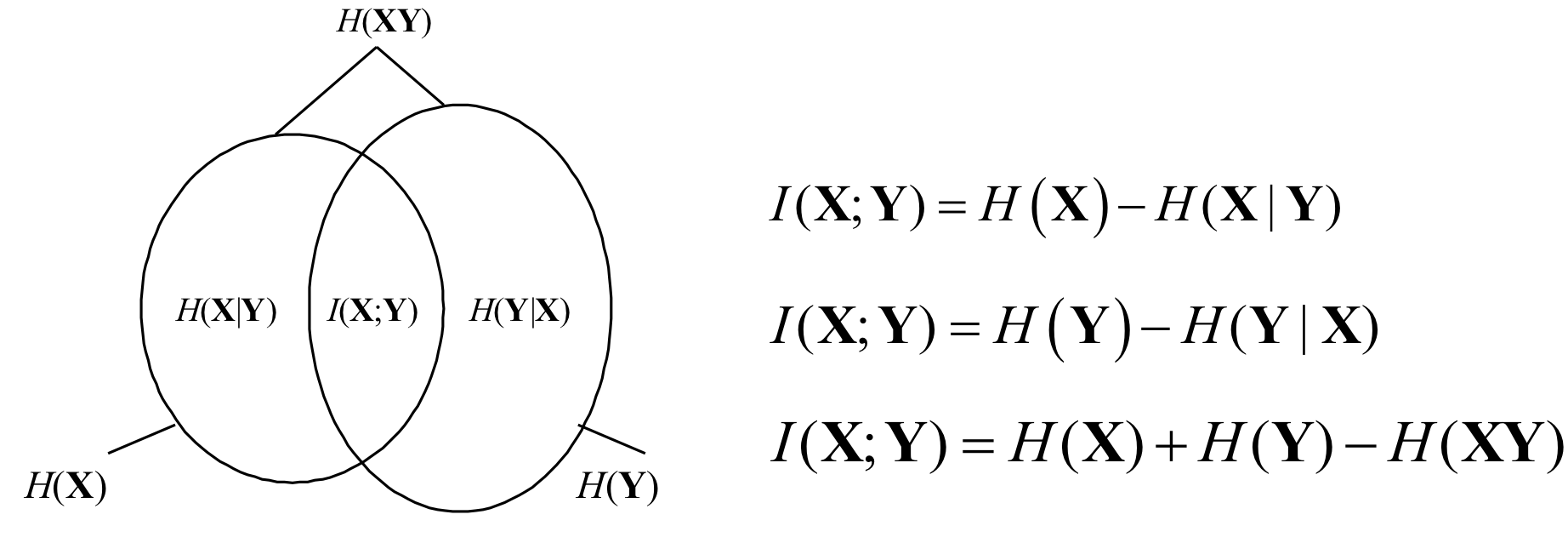

- 与各种熵的关系:, 为共熵,或称联合熵

- 非负性,当且仅当 独立时取零

- 上界:

- 平均互信息量仅和信源概率分布 和信道传递概率 有关

- 给定信道传递概率 时, 是 的上凸函数

- 给定信源概率分布 时, 是 的下凸函数

最大平均互信息量:信道容量

平均互信息量的物理意义

- 平均互信息量为 信源熵减掉一个条件熵

- 表示以信源为参考,在接收端平均每收到一个符号所获得的信息量

- 条件熵 表示了干扰或噪声,又称疑义度

- 平均互信息量为 信源熵减掉一个条件熵

- 表示以信源为参考,在接收端平均每收到一个符号所获得的信息量

- 条件熵 唯一确定信道噪声和干扰所需的平均互信息量,又称噪声熵、散布度

信源空间题:TODO

- 先求各联合概率

- 再求

- 最后求题目要求的

定义 2.9 若对应于 x 有两种分布 ,则 称为这两种分布的相对熵,又称 熵差

定义 2.10 平均互信息量用相对熵定义:

平均条件互信息量:条件互信息量在概率空间 的统计平均

有:(去掉就超简单)

2-4 多维随机变量的熵

二维随机变量的共熵: (对数相乘)

多维随机变量的共熵,又称熵的链接准则:

熵的条件似乎可以直接“忽略”

多维信源的平均互信息量,又称信息链接准则:

定理 2.1 n 维随机变量的共熵不大于其各自熵之和,即 ,称为熵的界

当 同分布时,上界变为

常用:

定理 2.2 数据处理定理 若 (马氏链,有 ),则有数据处理不等式

当消息通过级联处理时,其输入和输出消息之间的平均互信息量,不会超过输入消息与中间消息之间的平均互信息量,也不会超过中间消息与输出消息之间平均互信息量;即 级联只会使得输入与输出间的平均互信息量变小

数据处理只是变换形态,不会创造新的信息